三步提升安全水位|恒脑智鉴助力政务DeepSeek安全接入

政务服务转型

数字化浪潮席卷的当下,政务服务正处于转型升级的关键时期。社会公众对政务服务的期望不断攀升,高效、精准、公开已成为衡量政务服务质量的重要标尺,但政务服务面临的信息孤立、流程繁琐等障碍不容忽视。DeepSeek等大模型技术凭借数据处理、自然语言理解等能力,深度融入政务服务,提升效率,推动治理能力现代化,但也存在数据安全与伦理风险。

DeepSeek等大模型赋能政务助力效能提升

AI正逐步跃升为政务系统的核心驱动引擎,构筑起政务信息化的基石,取代了以往“人工+流程”的传统业务方式,也催生了诸如自动审批、智能预警等功能的应用。与此同时,DeepSeek等大模型借助精准图像识别、语音识别与自然语言处理等先进技术,能够针对高频政务事务实现高度精确的自动化处理。基于大模型的深度应用,所形成的“即时审批、即刻办理”高效模式,极大提升了政务效能,推进了政务数字化、智能化转型。

政务大模型应用风险与挑战

研究认为,当前政务大模型主要面临四个方面的安全风险,尤其在语料收集与内容生成方面,亟需系统、标准的政务大模型评估规范进行指导,否则极有可能在社会层面引发重大影响。

语料安全风险

政务大模型涉及大量敏感的政务数据,若数据管理不善或存在漏洞,可能导致数据泄露、滥用、误用或被非法访问。这不仅会侵犯个人隐私,还可能对国家安全和公共利益造成严重影响。

运行环境风险

政务大模型本身运行环境可能存在被恶意篡改、植入后门或遭受其他形式攻击的风险。这些攻击可能导致模型失效、输出错误结果或泄露敏感信息。

模型安全风险

政务大模型由于参数规模庞大、结构复杂等特点,存在算法不透明、可解释性差等问题。这些问题可能导致模型在决策过程中缺乏透明度和可解释性,进而引发公众对模型决策的质疑和不信任。

生成内容风险

政务大模型在生成内容时受到训练语料、算法设计等多种因素的影响,导致生成的内容存在偏差、错误或误导性。这些风险可能对政府决策、公共服务和社会舆论产生负面影响。

恒脑智鉴:三步提升安全水位

恒脑智鉴是一套专为评估和缓解大模型在数据处理、模型部署和应用上线中的风险而设计的风险管理平台。结合先进的内容检测引擎与恒脑判定模型,帮助客户审查大模型生成内容。

模型训练阶段,扫描语料库

识别风险数据

针对文本信息、爬虫信息、特定领域信息、结构化与半结构数据等数据类型,恒脑智鉴可采用规则检测与AI语义识别的方式进行敏感信息的发现及分类分级,助力业务人员识别数据安全风险,避免违规数据投喂。

训练部署阶段,检测系统应用

发现运行环境风险

大型模型的运行环境,涵盖操作系统、应用程序及模型框架等关键组件,其潜在的漏洞问题不容忽视。恒脑智鉴通过实时更新大型模型的漏洞防护策略,借助高效的漏洞扫描机制,推动大型模型网络安全的强化与巩固。

模型应用阶段 ,检测内容风险

评估合规与自身风险

通过提示词工程及 RAG 知识库技术,恒脑智鉴能够对违规内容、恶意代码生成、内容幻觉、代码理解能力、应答 / 拒答、正向引导等6种大模型输出风险进行智能化分析,并结合《生成式人工智能服务安全基本要求》自动化输出5大类31小类内容安全判定符合情况。

以AI+安全触达未来

在未来,构建集大模型安全政府监管、生态培育、企业自检及测试验证于一体的“多元协同”治理框架,将成为必然趋势。安恒信息将以树立AI文明为愿景,全力推动AI+安全技术的稳健前行,携手各界共同塑造一个全新的AI+安全生态环境。

AI+安全

AI+安全 数据安全

数据安全 数据基础设施

数据基础设施 态势感知

态势感知 云安全

云安全 基础安全

基础安全 终端安全

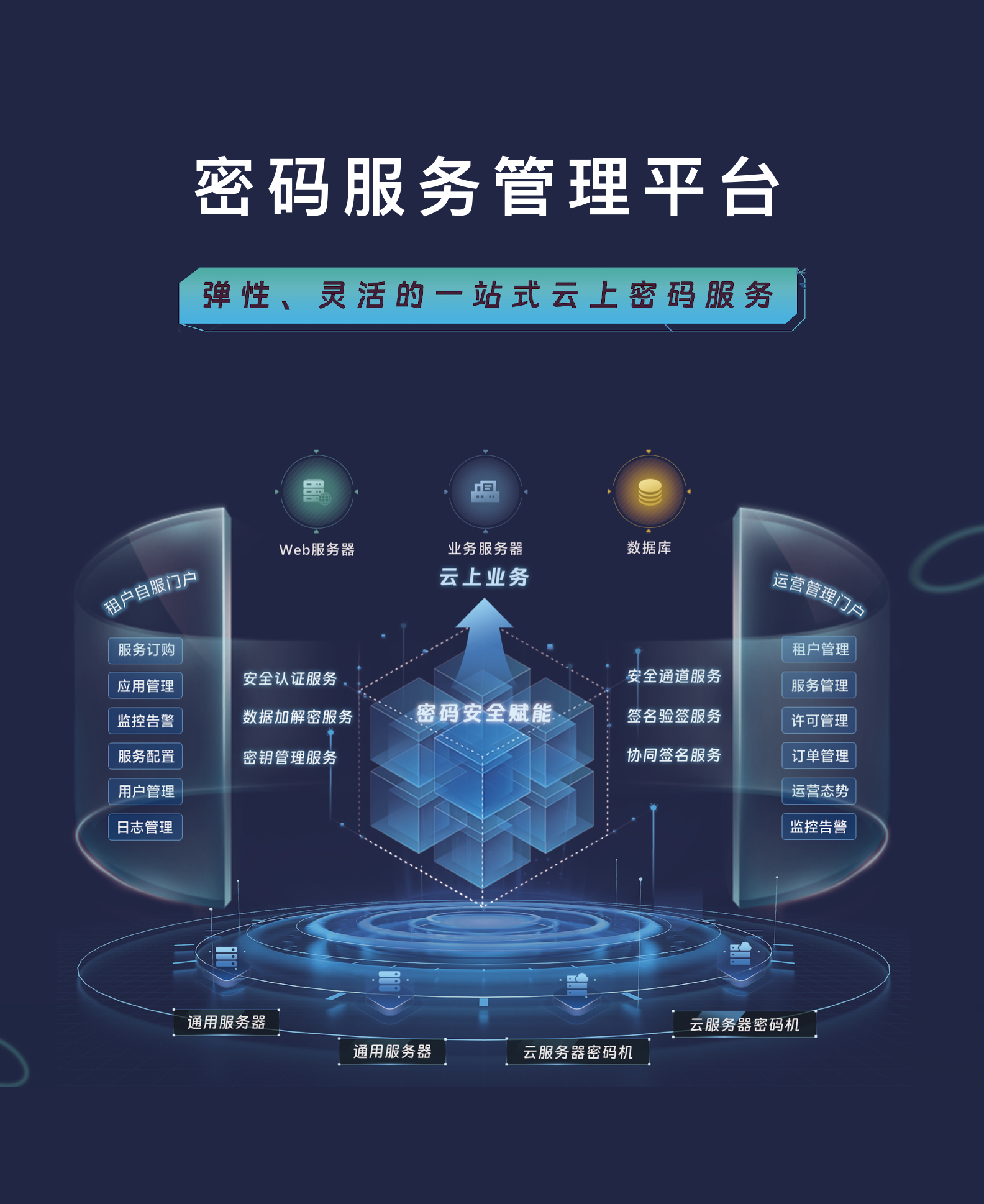

终端安全 商用密码

商用密码 软件供应链安全

软件供应链安全 网络空间靶场

网络空间靶场 工业互联网安全

工业互联网安全 物联网安全

物联网安全

安全托管服务

安全托管服务 运营管理服务

运营管理服务